A inicios de la semana apareció una nueva cuenta de Reddit en el foro r/AmItheAsshole, donde los usuarios someten sus problemas personales a la mediación de desconocidos. Este usuario en particular preguntaba si se había extralimitado al «negarse a cuidar a los hijos de su madrastra porque tiene su propio trabajo y responsabilidades». El post en sí era directo y gramaticalmente correcto, y explicaba una situación en la que la madrastra y el padre de la persona a menudo esperaban que esta cuidara a los niños con poca antelación, lo que finalmente llevó a una discusión.

«Ahora hay tensión en casa, y empiezo a preguntarme si lo manejé mal. Entiendo que criar niños es estresante, pero también siento que no debería estar obligado a asumir esa responsabilidad cuando no es mi papel», concluía el redditor. Las respuestas a este individuo fueron mayoritariamente de apoyo: Mucha gente respondió que los niños no eran suyos y que lo mejor sería irse de casa.

Pero según el software de detección de IA desarrollado por Pangram Labs, que afirma tener una tasa de precisión del 99.98% y una tasa de falsos positivos de solo uno entre 10,000, la historia original de discordia familiar fue generada por IA.

Qué hace Pangram Labs

Lo vi marcado como contenido de IA mientras me desplazaba por la página gracias a la última versión de la extensión de Chrome de Pangram, que se lanza al público esta semana; en el nivel de pago de 20 dólares al mes, la herramienta escanea publicaciones en redes sociales como Reddit, X, LinkedIn, Medium y Substack en tiempo real, etiquetándolas como escritas por humanos, generadas por IA o redactadas con ayuda de IA. El análisis también incluye una medida de la confianza en la conclusión: baja, media o alta.

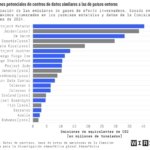

Los investigadores han encontrado bazofia de IA por todas partes en internet. Perjudica tanto al periodismo como a las plataformas sociales. Según un estudio publicado este mes por investigadores de la Universidad de Stanford, el Imperial College de Londres e Internet Archive, más de un tercio de todos los sitios web nuevos a partir de 2025 serán generados, al menos en parte, por IA. Los investigadores utilizaron herramientas anteriores de Pangram para llegar a sus conclusiones.

Este es el caos que Max Spero, CEO de Pangram y autodenominado » limpiador de basura», quiere ayudar a solucionar. En declaraciones a WIRED, afirma que añadir análisis instantáneos a la extensión de navegador de la empresa ofrece a los usuarios una forma más sencilla de comprobar si hay contenido de IA en los sitios web que frecuentan: «Al ofrecer controles proactivos, puede resultar mucho más útil para las personas que simplemente se preocupan por evitar errores. Es un gran esfuerzo copiar y pegar texto en una herramienta externa. La gente simplemente no lo va a hacer».

Por supuesto, los escenarios inventados no son nada fuera de lo común en subreddits como r/AmItheAsshole, donde los trolls son conocidos por publicar contenido para generar interacción, especialmente ficciones absurdas. Sin embargo, incluso el lector más perspicaz podría no sospechar que una narración común, como la descrita anteriormente, sea falsa. El usuario de Reddit que la compartió no respondió a la solicitud de comentarios sobre si había utilizado IA o qué esperaba lograr con la publicación. Tiempo después, la borró.

Aunque ningún sistema de detección de IA es perfecto, el de Pangram está considerado el más coherente y preciso por investigadores externos de varias universidades; un estudio de 2025 de la Universidad de Chicago en el que se auditaba el software de detección de IA otorgó a Pangram la máxima calificación y señaló que su tasa de falsos positivos era casi nula, especialmente en los pasajes más largos. Spero afirma que una de las razones por las que supera a sus competidores es que está entrenado en parte con «ejemplos más difíciles que están más cerca del límite entre la IA y el ser humano». Al probarlo con artículos publicados en WIRED, no conseguí que generara un falso positivo.